Responsabilidad de los Chatbots de IA: ¿Quién Paga Cuando la Inteligencia Artificial Causa Daños?

Comprenda la responsabilidad de los chatbots de IA en 2026. Descubra quién es responsable cuando la IA causa daños o lesiones. Contacte a Vasquez Law Firm para una consulta gratuita.

Vasquez Law Firm

Publicado el 7 de marzo de 2026

¿Tiene preguntas? Hable con un abogado — consulta gratuita.

Llame 1-844-967-3536Responsabilidad de los Chatbots de IA: ¿Quién Paga Cuando la Inteligencia Artificial Causa Daños?

Imagine un escenario en el que un chatbot de IA (inteligencia artificial) proporciona un consejo médico incorrecto, lo que lleva a una grave complicación de salud, o quizás la IA de un coche autónomo comete un error fatal. A medida que la inteligencia artificial se integra más en nuestra vida diaria, las preguntas sobre la responsabilidad de los chatbots de IA ya no son teóricas. En 2026, entender quién es legalmente responsable cuando la IA causa daños es fundamental tanto para consumidores como para empresas, especialmente en reclamaciones por lesiones personales. Si usted o un ser querido ha resultado herido debido a una IA defectuosa, buscar asesoramiento legal es un primer paso esencial para proteger sus derechos.

¿Necesita ayuda con su caso? Nuestros abogados experimentados están listos para luchar por usted. Se Habla Español.

¿Necesita ayuda legal?

Consulta gratuita de 15 minutos. Manejamos inmigración, tráfico, familia, criminal y lesiones personales en NC y FL.

O llámenos ahora: 1-844-967-3536

Respuesta Rápida

La responsabilidad de los chatbots de IA suele recaer en marcos legales existentes como la responsabilidad por productos (product liability), la negligencia (negligence) o la mala praxis profesional (professional malpractice), dependiendo de la función de la IA y del daño causado. Determinar la responsabilidad implica identificar si el desarrollador, el implementador o el usuario tienen la culpa. Los factores clave incluyen el diseño de la IA, su uso previsto y la previsibilidad del daño.

- La responsabilidad por productos se aplica si la IA es un producto defectuoso.

- Las reclamaciones por negligencia surgen de un incumplimiento del deber de diligencia (duty of care).

- La mala praxis profesional puede aplicarse si la IA actúa como un profesional.

- Establecer la causalidad entre la acción de la IA y el daño es crucial.

- Está surgiendo nueva legislación para abordar las lagunas de responsabilidad específicas de la IA.

El Lado Oscuro de la IA: Entendiendo la Responsabilidad de los Chatbots de IA

A finales de 2025, la familia de un hombre de Florida presentó una demanda contra una empresa de chatbots de IA, alegando que el consejo perjudicial del bot contribuyó a su muerte. Este trágico caso, destacado en un blog de leyes de lesiones de Florida, subraya la necesidad urgente de definir la responsabilidad de los chatbots de IA. A medida que los sistemas de IA se vuelven más sofisticados y autónomos, determinar quién es responsable de sus acciones se vuelve cada vez más complejo. Las doctrinas legales tradicionales están siendo puestas a prueba a medida que los tribunales lidian con estos problemas novedosos en 2026.

El desafío central radica en la naturaleza misma de la IA. A diferencia de un producto tradicional, un chatbot de IA aprende y evoluciona, generando potencialmente resultados imprevistos. Esta adaptabilidad dificulta la identificación de un único punto de falla o intención, que a menudo son los pilares del derecho de responsabilidad. Los expertos legales están explorando cómo las leyes existentes, como la responsabilidad por productos, la negligencia e incluso la mala praxis profesional, pueden aplicarse a los daños generados por la IA. El resultado de estos casos dará forma significativa al futuro del desarrollo y la regulación de la IA.

Para las personas en Carolina del Norte y Florida que sufren daños debido a la IA, comprender estos paisajes legales en evolución es primordial. Ya sea que el sistema de IA haya proporcionado consejos erróneos, haya cometido un error en un vehículo autónomo o haya causado una violación de datos, el camino para buscar compensación requiere un conocimiento legal especializado. Vasquez Law Firm está monitoreando de cerca estos desarrollos para brindar orientación informada a las víctimas de lesiones relacionadas con la IA.

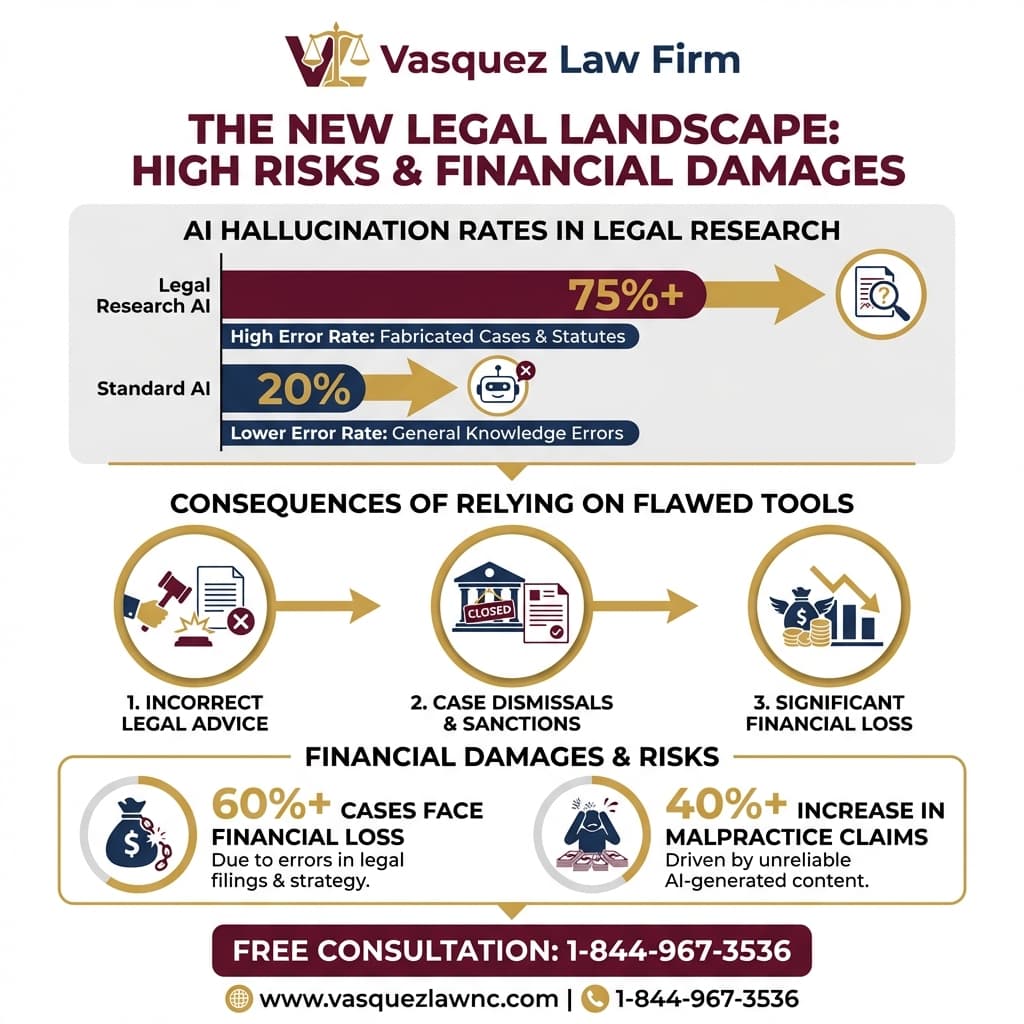

Infografía: Áreas Clave de la Responsabilidad de los Chatbots de IA

Esta infografía ilustra las diferentes teorías legales que pueden aplicarse a la responsabilidad de los chatbots de IA, ayudándole a entender dónde podría recaer la responsabilidad.

Objetivo: Simplificar las complejas teorías legales aplicables a la responsabilidad de los chatbots de IA.

Ubicación: Después de la sección inicial de comprensión de la responsabilidad.

Bloques de Datos:

- Responsabilidad por Productos (Product Liability): La IA como producto defectuoso.

- Negligencia (Negligence): Falta de ejercicio de cuidado razonable.

- Mala Praxis Profesional (Professional Malpractice): La IA actuando en una capacidad profesional.

- Responsabilidad Estricta (Strict Liability): Para actividades ultra-peligrosas.

- Legislación Emergente: Nuevas leyes específicamente para la IA.

Diseño: Una imagen central de un chatbot con líneas que irradian hacia cada teoría legal, cada una con una breve definición.

Micro CTA: Llame hoy para obtener ayuda.

Texto Alt: Infografía que detalla las áreas clave de la responsabilidad de los chatbots de IA, incluyendo responsabilidad por productos, negligencia, mala praxis profesional, responsabilidad estricta y legislación emergente, con una ilustración de un chatbot en el centro.

Nombres de Archivo SEO: ai-chatbot-liability-areas.webp

Marcos Legales: Responsabilidad por Productos y Negligencia en Casos de IA

Cuando un chatbot de IA causa daños, los expertos legales a menudo recurren primero a doctrinas establecidas como la responsabilidad por productos (product liability). Este marco suele aplicarse cuando un producto defectuoso causa una lesión. Por ejemplo, si un sistema de IA incrustado en un dispositivo médico funciona mal, lo que provoca daños al paciente, podría tratarse como un caso de responsabilidad por productos. Los elementos cruciales aquí son un defecto de diseño, fabricación o advertencia, y que el defecto haya causado la lesión. Sin embargo, el 'producto' en este contexto es a menudo software, lo que complica las definiciones tradicionales.

La negligencia (negligence) es otra vía legal común. Esto implica probar que una parte (como el desarrollador o el implementador de la IA) tenía un deber de diligencia (duty of care), incumplió ese deber, y este incumplimiento causó directamente las lesiones del demandante. Considere un chatbot de IA diseñado para el apoyo a la salud mental que da consejos peligrosamente engañosos. Si los desarrolladores no probaron adecuadamente el bot, no implementaron protocolos de seguridad o no advirtieron a los usuarios de sus limitaciones, podrían ser considerados negligentes. El desafío es establecer el deber de diligencia específico que el creador u operador de un sistema de IA debe.

En Carolina del Norte, las reclamaciones por lesiones personales (personal injury claims) requieren demostrar estos elementos claramente. Los tribunales de Raleigh, por ejemplo, examinarán si los creadores de la IA actuaron razonablemente en su desarrollo e implementación. La naturaleza evolutiva de la IA significa que lo que constituye 'cuidado razonable' se está redefiniendo continuamente. Esto hace que sea vital trabajar con un abogado de lesiones personales que comprenda tanto el derecho de daños (tort law) tradicional como el panorama legal emergente de la inteligencia artificial.

Escenarios Comunes Donde Surge la Responsabilidad de los Chatbots de IA

Los ejemplos de responsabilidad de los chatbots de IA son cada vez más frecuentes. Un escenario implica que el sistema de IA de un vehículo autónomo cometa un error de juicio que resulte en una colisión y lesiones. Aquí, el enfoque a menudo se desplaza hacia el fabricante del vehículo, el desarrollador de la IA, o incluso el propietario, dependiendo del nivel de autonomía e intervención humana. Otro ejemplo es la IA financiera, donde un algoritmo proporciona consejos de inversión incorrectos, lo que lleva a pérdidas financieras significativas para un individuo. Probar la causalidad y los daños en tales casos requiere una profunda comprensión técnica y legal.

Los chatbots médicos de IA presentan otra área compleja. Si una IA de diagnóstico malinterpreta los síntomas, lo que lleva a un diagnóstico tardío o incorrecto, el paciente podría sufrir graves consecuencias. En tales casos, surgen preguntas sobre si la IA actúa como una herramienta bajo la supervisión de un médico, o si se considera una entidad independiente. Esta distinción es crucial para determinar si la mala praxis médica (medical malpractice) o la responsabilidad por productos (product liability) es el camino legal apropiado. Los detalles del papel de la IA y la supervisión humana involucrada son clave para evaluar la responsabilidad.

Finalmente, considere los chatbots de IA utilizados en el servicio al cliente o la asistencia legal. Si una IA proporciona información legal inexacta en la que un usuario confía en su detrimento, ¿quién es responsable? La empresa que implementa el chatbot podría ser responsable por tergiversación o negligencia, especialmente si no verificó adecuadamente la información de la IA. Estos escenarios variados resaltan por qué un enfoque matizado de la responsabilidad de los chatbots de IA es esencial en 2026, combinando principios legales tradicionales con una comprensión de la tecnología avanzada.

Nueva Legislación y el Futuro de la Responsabilidad de la IA

A medida que la IA avanza rápidamente, las leyes existentes luchan por mantenerse al día, lo que lleva a la demanda de nueva legislación que aborde específicamente la responsabilidad de los chatbots de IA. En 2026, varios estados y el gobierno federal están considerando proyectos de ley para aclarar estos problemas. Nueva York, por ejemplo, ha propuesto legislación que crearía una responsabilidad específica para los desarrolladores e implementadores de chatbots bajo ciertas circunstancias. Estos esfuerzos tienen como objetivo proporcionar directrices más claras para la rendición de cuentas y fomentar el desarrollo responsable de la IA, asegurando que las víctimas tengan un camino claro hacia la justicia.

A nivel internacional, la Unión Europea ha estado a la vanguardia de la regulación de la IA, con su Ley de IA (AI Act) estableciendo un estándar global para enfoques basados en el riesgo para la IA. Si bien el sistema legal de EE. UU. se basa en gran medida en el derecho consuetudinario (common law) y los estatutos existentes, estos desarrollos internacionales a menudo influyen en las discusiones legislativas estadounidenses. El objetivo es equilibrar la innovación con la seguridad pública, asegurando que los beneficios de la IA no se obtengan a costa de la rendición de cuentas por los daños. Este panorama legal en evolución significa que cualquier persona que se enfrente a lesiones relacionadas con la IA necesita un abogado bien versado tanto en la ley actual como en las tendencias futuras.

Es probable que el sistema legal de EE. UU. vea una combinación de nuevos estatutos e interpretaciones judiciales de las leyes existentes para abordar los desafíos específicos de la IA. Este entorno dinámico enfatiza la importancia de mantenerse informado y buscar asesoramiento legal experto. Para las personas en Carolina del Norte o Florida que enfrentan daños relacionados con la IA, comprender estos cambios legislativos es crucial para presentar una reclamación exitosa. Vasquez Law Firm se dedica a mantenerse a la vanguardia de estos cambios legales para servir mejor a nuestros clientes.

No enfrente sus desafíos legales solo. Nuestro equipo está aquí para ayudarle en cada paso del camino.

Obtenga Su Evaluación de Caso Gratuita

Llame hoy: 1-844-967-3536 | Se Habla Español

Protegiendo Sus Derechos Después de una Lesión Relacionada con la IA

Si sospecha que un chatbot o sistema de IA causó su lesión, las consecuencias inmediatas pueden ser confusas. Su primera prioridad debe ser su salud y seguridad. Busque atención médica para cualquier lesión sufrida y asegúrese de que todos los incidentes estén debidamente documentados. La recopilación de pruebas es crucial en cualquier reclamación por lesiones personales, y los casos relacionados con la IA no son una excepción. Esto podría incluir capturas de pantalla de interacciones con el chatbot, registros de uso, datos del dispositivo o cualquier otra información que vincule la acción de la IA con su daño. Una acción oportuna puede afectar significativamente su capacidad para presentar una reclamación.

Luego, contacte a un abogado experimentado en lesiones personales. Los casos que involucran la responsabilidad de los chatbots de IA son complejos y requieren un conocimiento especializado tanto de la tecnología como del derecho. Un abogado puede ayudarle a identificar a las partes potencialmente responsables, que podrían incluir al desarrollador de la IA, la empresa que implementó la IA o incluso un proveedor de servicios externo. También le guiarán a través del proceso de preservación de pruebas, la navegación de complejidades legales y la comprensión de las leyes específicas que se aplican en Carolina del Norte o Florida.

Recuerde, existen plazos estrictos, conocidos como estatutos de limitaciones (statutes of limitations), para presentar demandas por lesiones personales. Incumplir estos plazos puede impedir permanentemente su derecho a una compensación. Por ejemplo, en Carolina del Norte, el estatuto de limitaciones general para lesiones personales es de tres años a partir de la fecha de la lesión. (N.C. Gen. Stat. § 1-52). Consultar con un abogado de inmediato asegura que su reclamación se presente dentro del plazo necesario y que se cumplan todos los requisitos legales. Su abogado trabajará para construir un caso sólido y abogar por la compensación que usted merece.

Qué Esperar al Presentar una Reclamación de Responsabilidad por IA

Presentar una reclamación de responsabilidad por chatbot de IA implica varias etapas distintas, a menudo más complejas que los casos tradicionales de lesiones personales. Inicialmente, su abogado llevará a cabo una investigación exhaustiva, que puede implicar un análisis forense del sistema de IA, testimonio de expertos sobre su diseño y función, y una revisión detallada de todas las interacciones. Esta fase es crítica para establecer un vínculo claro entre las acciones de la IA y sus lesiones. Identificar el defecto específico o el acto negligente es primordial para una reclamación exitosa.

Tengo un Caso de Lesiones Personales?

Responda 3 preguntas rapidas para descubrirlo

Pregunta 1 / 3

Que le paso?

Después de la investigación, su abogado normalmente enviará una carta de demanda (demand letter) a las partes responsables y a sus compañías de seguros. Esta carta describe los hechos del caso, el alcance de sus lesiones y la compensación solicitada. Pueden seguir negociaciones, donde ambas partes intentan llegar a un acuerdo. Si no se puede lograr un acuerdo justo, el caso puede proceder a litigio, lo que implica descubrimiento (discovery), declaraciones juradas (depositions) y potencialmente un juicio. La duración de este proceso puede variar ampliamente, desde varios meses hasta varios años, dependiendo de la complejidad y la voluntad de las partes para negociar.

A lo largo de este proceso, deberá proporcionar documentación de su tratamiento médico, salarios perdidos y cualquier otro daño que haya incurrido. Su equipo legal en Vasquez Law Firm le guiará en cada paso, asegurándose de que comprenda el proceso y sus opciones. Estamos comprometidos a luchar incansablemente en su nombre para asegurar la máxima compensación por su sufrimiento. Nuestro objetivo es aliviar la carga legal para que pueda concentrarse en su recuperación.

Acerca de Vasquez Law Firm

En Vasquez Law Firm, combinamos la compasión con una representación agresiva. Nuestro lema "Yo Peleo" refleja nuestro compromiso de defender sus derechos. Entendemos el costo físico, emocional y financiero que las lesiones pueden cobrar a individuos y familias, especialmente cuando son causadas por tecnologías emergentes como la IA. Nuestro equipo se dedica a brindar servicios legales personalizados, asegurando que su voz sea escuchada y que su caso reciba la atención que merece.

- Apoyo Bilingüe: Se Habla Español - nuestro equipo es completamente bilingüe y está listo para ayudar a los clientes tanto en inglés como en español, asegurando una comunicación y comprensión claras a lo largo de su proceso legal.

- Áreas de Servicio: Servimos con orgullo a clientes en Carolina del Norte y Florida para casos de lesiones personales y otros casos específicos del estado, y a nivel nacional para servicios de inmigración. Nuestra oficina de Raleigh está estratégicamente ubicada para servir eficazmente a la comunidad.

- Experiencia: Con más de 15 años de experiencia legal dedicada, el Abogado Vasquez aporta una gran cantidad de conocimientos y un historial probado de éxito en asuntos legales complejos, incluyendo lesiones personales, compensación de trabajadores y defensa criminal.

- Resultados: Hemos manejado con éxito miles de casos, asegurando resultados favorables y una compensación sustancial para nuestros clientes. Nuestro enfoque agresivo asegura que las compañías de seguros y las partes responsables rindan cuentas.

Confianza y Experiencia del Abogado

El Abogado Vasquez posee un título de Doctor en Jurisprudencia (Juris Doctor) y está admitido para ejercer en el Colegio de Abogados del Estado de Carolina del Norte y en el Colegio de Abogados de Florida. Con más de 15 años de experiencia legal dedicada, ha construido una reputación por brindar atención personalizada y lograr resultados favorables para sus clientes. Su compromiso con la justicia y su tenaz defensa lo convierten en un aliado de confianza para quienes enfrentan situaciones legales desafiantes. Comprende los matices del derecho de lesiones personales, incluidas las complejidades emergentes de la responsabilidad de los chatbots de IA, y trabaja incansablemente para proteger los intereses de sus clientes.

Preguntas Frecuentes

¿Puedo demandar a una empresa de chatbot de IA por angustia emocional?

Potencialmente, sí. Si las acciones de un chatbot de IA causan directa y previsiblemente una angustia emocional severa, usted podría tener motivos para una reclamación. Esto a menudo se enmarca en negligencia o infligir intencionalmente angustia emocional, dependiendo de la programación de la IA y la naturaleza de la interacción dañina. Probar la causalidad y la gravedad de la angustia sería fundamental para un caso exitoso.

¿La responsabilidad del chatbot de IA es diferente para los vehículos autónomos?

Sí, la responsabilidad del chatbot de IA puede diferir significativamente para los vehículos autónomos. Estos casos a menudo implican complejas teorías de responsabilidad por productos (product liability), centrándose en el hardware, software y sistemas de sensores del vehículo. También están surgiendo regulaciones específicas para coches autónomos, que pueden definir la responsabilidad de manera más clara. El marco legal considera el nivel de supervisión humana y el papel de la IA en el accidente.

¿Cómo pruebo que un chatbot de IA causó mi lesión?

Probar que un chatbot de IA causó su lesión requiere testimonio de expertos, análisis forense de los datos de la IA y documentación detallada de sus interacciones. Deberá establecer un vínculo causal directo entre la acción específica de la IA (por ejemplo, consejo defectuoso, cálculo incorrecto) y el daño resultante. Este proceso a menudo involucra a expertos técnicos y legales para reconstruir los eventos.

¿Quién es típicamente responsable de los errores del chatbot de IA?

La responsabilidad por los errores del chatbot de IA puede recaer en el desarrollador, el implementador (la empresa que utiliza la IA), o a veces incluso en el usuario, dependiendo de las circunstancias. Los factores incluyen el diseño de la IA, su uso previsto, si se utilizó según lo previsto y la previsibilidad del error. Una nueva legislación podría aclarar aún más estos roles en 2026.

¿Existen nuevas leyes para la responsabilidad de la IA en Carolina del Norte?

A partir de 2026, Carolina del Norte está monitoreando activamente los desarrollos federales e internacionales con respecto a la responsabilidad de la IA. Si bien no se ha promulgado ninguna ley integral específica de responsabilidad de la IA, se están adaptando los estatutos existentes de lesiones personales y responsabilidad por productos. Los legisladores están considerando cómo abordar mejor los desafíos únicos planteados por la IA en varios sectores, incluidos la atención médica y el transporte.

¿Qué es la Ley AI LEAD?

La Ley AI LEAD (AI Liability for Error and Damage Act) es una legislación federal propuesta destinada a establecer un marco para la responsabilidad de los chatbots de IA en todo Estados Unidos. Busca aclarar la responsabilidad por los daños inducidos por la IA, promover el desarrollo transparente de la IA y garantizar la compensación para las víctimas. Si bien aún no es ley, representa un paso significativo hacia la regulación federal de la IA.

¿Puede una empresa ser considerada estrictamente responsable por daños causados por la IA?

La responsabilidad estricta (strict liability) podría aplicarse si el sistema de IA se considera una actividad inherentemente peligrosa o ultra-peligrosa, o si se considera un producto defectuoso. Esto significa que la responsabilidad podría asignarse independientemente de la culpa o la negligencia. Sin embargo, aplicar la responsabilidad estricta a la IA es un área del derecho compleja y en evolución, a menudo debatida en los tribunales y los órganos legislativos.

¿Qué papel juegan los descargos de responsabilidad en la responsabilidad del chatbot de IA?

Los descargos de responsabilidad pueden jugar un papel, pero no siempre eximen completamente a una empresa de la responsabilidad del chatbot de IA. Si bien los descargos de responsabilidad pueden informar a los usuarios sobre las limitaciones, es posible que no protejan contra negligencia grave, mala conducta intencional o ciertos defectos del producto. Los tribunales examinarán la claridad, la prominencia y la razonabilidad de los descargos de responsabilidad a la luz del daño causado.

Fuentes y Referencias

- Tribunales de Carolina del Norte

- Instituto de Información Legal de Cornell Law School: Responsabilidad por Productos

- Departamento de Transporte de Carolina del Norte (NCDOT)

¿Listo para dar el siguiente paso? Contacte a Vasquez Law Firm hoy para una consulta gratuita y confidencial. Estamos comprometidos a luchar por sus derechos y lograr el mejor resultado posible para su caso.

Comience Su Consulta Gratuita Ahora

Llámenos: 1-844-967-3536

Se Habla Español - Estamos aquí para ayudarle.

Lesionado? Puede Tener Derecho a Compensacion

Sin cobro a menos que ganemos. Luchamos por la maxima recuperacion.

Vasquez Law Firm

Legal Team

Our experienced attorneys at Vasquez Law Firm have been serving clients in North Carolina and Florida since 2011, with 70+ years of combined attorney experience. We specialize in immigration, personal injury, criminal defense, workers compensation, and family law.